类ChatGPT开源大语言模型MPT-7B,该项目具备可商业化、高性能、资源消耗低、1T训练数据、可生成代码等技术优势。MPT-7B 在MosaicML平台上进行了9.5天的训练,零人工干预,成本仅用了20万美元。

截至目前,MPT-7B开源项目的下载量超过300万次,AI2、Generally Intelligence、Hippocratic AI、Replit 和 Scatter Labs等知名客户皆使用其产品,开发各种生成式AI产品。Databricks表示,这也是收购MosaicML的重要原因之一。

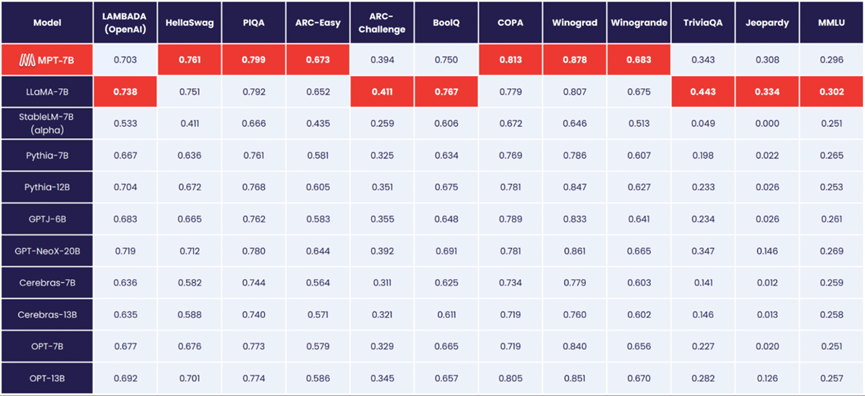

性能方面,MPT-7B与LLaMA-7B、StablelM-7B (alpha) 、Pythia-7B 、Pythia-128、 GPTJ-68、GPT-Neox-208、Cerebras-7B、 Cerebras-13B、OPT-7B、OPT-138同类产品进行了比较,在6个项目中优于其他模型,基本与LLaMA-7B性能持平。

支持84k tokens超长输入,并用FlashAttention和FasterTransformer方法针对训练和推理速度做过优化。

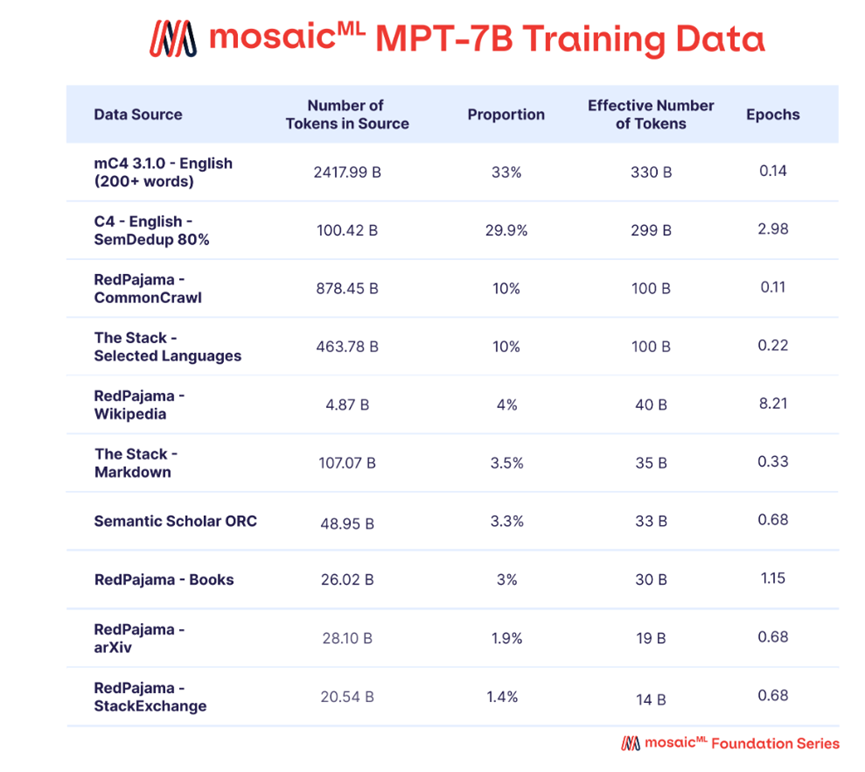

训练数据方面,MPT-7B使用了混合数据源,包括C4、维基百科、CommonCrawl、arXiv、Books和StackExchange等数据集,并且该模型针对1万亿个标记进行了预训练。

为了使模型具备代码生成的能力,MPT-7B还使用了The Stack的6.4TB的代码数据集,删除了包含的2.9TB重复数据。

该代码数据集包含358种编程语言,例如,C、C++、Java、Ruby、Scala、Scheme、Shell、Python等。

此外,MosaicML还提供大语言模型微调和预训练服务,支持云部署和完整数据隐私控制等。

京公网安备 11010502044423号

京公网安备 11010502044423号